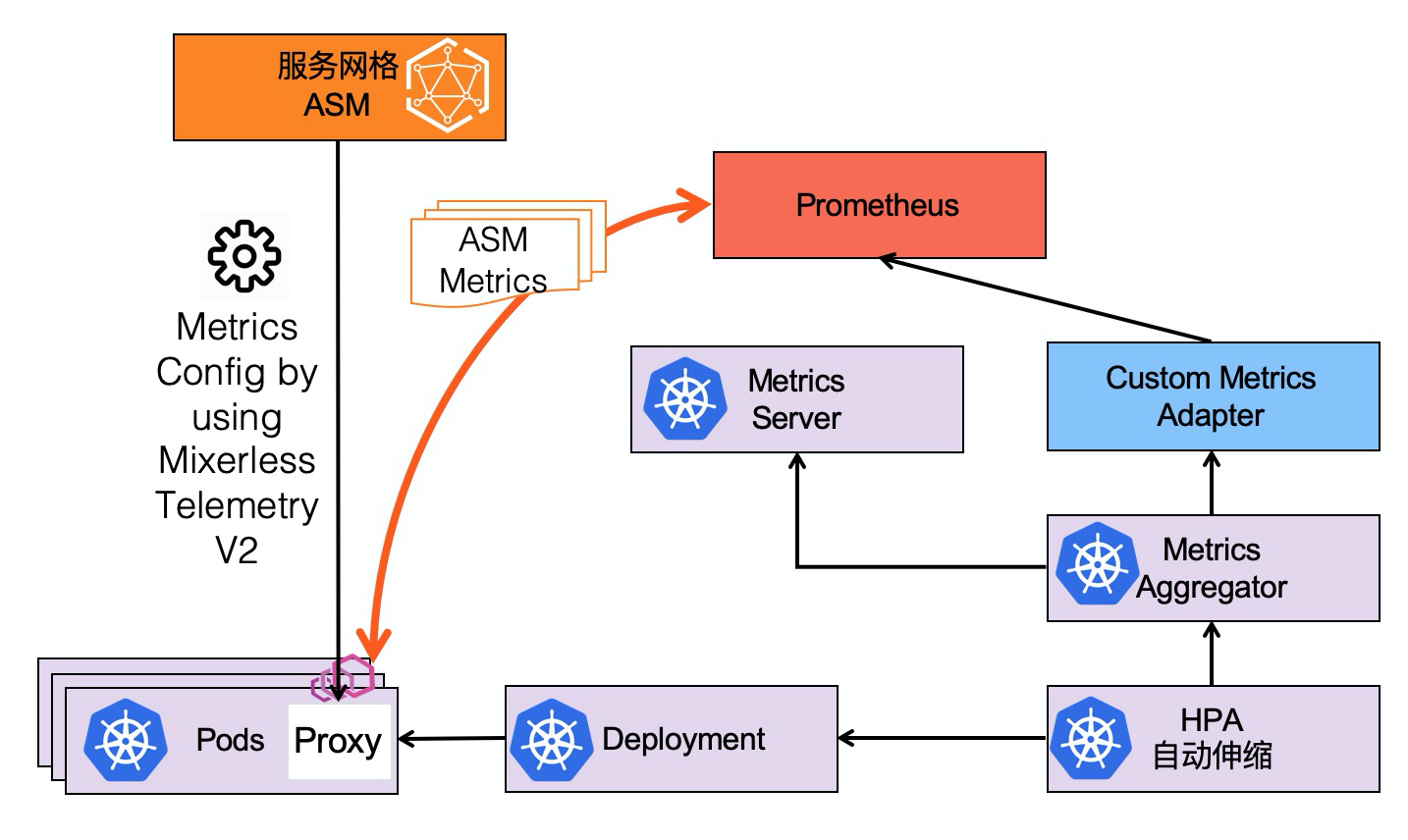

服務網格ASM為ACK集群內的服務通信提供了一種非侵入式的生成遙測數據的能力。這種遙測功能提供了服務行為的可觀測性,可以幫助運維人員對應用程序進行故障排除、維護和優化,而不會帶來任何額外負擔。根據監控的四個黃金指標維度(延遲、流量、錯誤和飽和度),服務網格ASM為管理的服務生成一系列指標。本文介紹如何使用ASM指標實現工作負載的自動彈性伸縮。

前提條件

已創建ACK集群。更多信息,請參見創建Kubernetes托管版集群。

已創建ASM實例。更多信息,請參見創建ASM實例。

已在ACK集群中創建Prometheus實例和Grafana示例。更多信息,請參見開源Prometheus監控。

已集成Prometheus實現網格監控。更多信息,請參見集成自建Prometheus實現網格監控。

背景信息

服務網格ASM為管理的服務生成一系列指標。更多信息,請參見Istio標準指標。

自動伸縮是一種根據資源使用情況進行自動擴縮工作負載的方法。Kubernetes中的自動伸縮具有以下兩個維度:

集群自動伸縮器CA(Cluster Autoscaler):用于處理節點伸縮操作,可以增加或減少節點。

水平自動伸縮器HPA(Horizontal Pod Autoscaler):用于自動伸縮應用部署中的Pod,可以調節Pod的數量。

Kubernetes提供的聚合層允許第三方應用程序將自身注冊為API Addon組件來擴展Kubernetes API。這樣的Addon組件可以實現Custom Metrics API,并允許HPA訪問任意指標。HPA會定期通過Resource Metrics API查詢核心指標(例如CPU或內存)以及通過Custom Metrics API獲取特定于應用程序的指標,包括ASM提供的可觀測性指標。

步驟一:開啟采集Prometheus監控指標

具體操作,請參見將監控指標采集到ARMS Prometheus。

步驟二:部署自定義指標API Adapter

執行以下命令,下載Adapter安裝包,然后在ACK集群中安裝部署自定義指標API Adapter。

關于Adapter安裝包的更多信息,請參見kube-metrics-adapter。

## 如果使用Helm v3。 helm -n kube-system install asm-custom-metrics ./kube-metrics-adapter --set prometheus.url=http://prometheus.istio-system.svc:9090安裝完成后,通過以下方式確認kube-metrics-adapter已啟用。

執行以下命令,確認

autoscaling/v2beta已存在。kubectl api-versions |grep "autoscaling/v2beta"預期輸出:

autoscaling/v2beta執行以下命令,確認kube-metrics-adapter Pod狀態。

kubectl get po -n kube-system |grep metrics-adapter預期輸出:

asm-custom-metrics-kube-metrics-adapter-85c6d5d865-2**** 1/1 Running 0 19s執行以下命令,列出Prometheus適配器提供的自定義外部指標。

kubectl get --raw "/apis/external.metrics.k8s.io/v1beta1" | jq .預期輸出:

{ "kind": "APIResourceList", "apiVersion": "v1", "groupVersion": "external.metrics.k8s.io/v1beta1", "resources": [] }

步驟三:部署示例應用

創建test命名空間。具體操作,請參見管理命名空間與配額。

啟用Sidecar自動注入。具體操作,請參見安裝Sidecar代理。

部署示例應用。

使用以下內容,創建podinfo.yaml文件。

apiVersion: apps/v1 kind: Deployment metadata: name: podinfo namespace: test labels: app: podinfo spec: minReadySeconds: 5 strategy: rollingUpdate: maxUnavailable: 0 type: RollingUpdate selector: matchLabels: app: podinfo template: metadata: annotations: prometheus.io/scrape: "true" labels: app: podinfo spec: containers: - name: podinfod image: stefanprodan/podinfo:latest imagePullPolicy: IfNotPresent ports: - containerPort: 9898 name: http protocol: TCP command: - ./podinfo - --port=9898 - --level=info livenessProbe: exec: command: - podcli - check - http - localhost:9898/healthz initialDelaySeconds: 5 timeoutSeconds: 5 readinessProbe: exec: command: - podcli - check - http - localhost:9898/readyz initialDelaySeconds: 5 timeoutSeconds: 5 resources: limits: cpu: 2000m memory: 512Mi requests: cpu: 100m memory: 64Mi --- apiVersion: v1 kind: Service metadata: name: podinfo namespace: test labels: app: podinfo spec: type: ClusterIP ports: - name: http port: 9898 targetPort: 9898 protocol: TCP selector: app: podinfo執行以下命令,部署podinfo。

kubectl apply -n test -f podinfo.yaml

為了觸發自動彈性伸縮,需要在命名空間test中部署負載測試服務,用于觸發請求。

使用以下內容,創建loadtester.yaml文件。

apiVersion: apps/v1 kind: Deployment metadata: name: loadtester namespace: test labels: app: loadtester spec: selector: matchLabels: app: loadtester template: metadata: labels: app: loadtester annotations: prometheus.io/scrape: "true" spec: containers: - name: loadtester image: weaveworks/flagger-loadtester:0.18.0 imagePullPolicy: IfNotPresent ports: - name: http containerPort: 8080 command: - ./loadtester - -port=8080 - -log-level=info - -timeout=1h livenessProbe: exec: command: - wget - --quiet - --tries=1 - --timeout=4 - --spider - http://localhost:8080/healthz timeoutSeconds: 5 readinessProbe: exec: command: - wget - --quiet - --tries=1 - --timeout=4 - --spider - http://localhost:8080/healthz timeoutSeconds: 5 resources: limits: memory: "512Mi" cpu: "1000m" requests: memory: "32Mi" cpu: "10m" securityContext: readOnlyRootFilesystem: true runAsUser: 10001 --- apiVersion: v1 kind: Service metadata: name: loadtester namespace: test labels: app: loadtester spec: type: ClusterIP selector: app: loadtester ports: - name: http port: 80 protocol: TCP targetPort: http執行以下命令,部署負載測試服務。

kubectl apply -n test -f loadtester.yaml

驗證部署示例應用和負載測試服務是否成功。

執行以下命令,確認Pod狀態。

kubectl get pod -n test預期輸出:

NAME READY STATUS RESTARTS AGE loadtester-64df4846b9-nxhvv 2/2 Running 0 2m8s podinfo-6d845cc8fc-26xbq 2/2 Running 0 11m執行以下命令,進入負載測試器容器,并使用hey命令生成負載。

export loadtester=$(kubectl -n test get pod -l "app=loadtester" -o jsonpath='{.items[0].metadata.name}') kubectl -n test exec -it ${loadtester} -c loadtester -- hey -z 5s -c 10 -q 2 http://podinfo.test:9898返回結果,生成負載成功,說明示例應用和負載測試服務部署成功。

步驟四:使用ASM指標配置HPA

定義一個HPA,該HPA將根據每秒接收的請求數來擴縮Podinfo的工作負載數量。當平均請求流量負載超過10 req/sec時,將指示HPA擴大部署。

使用以下內容,創建hpa.yaml。

apiVersion: autoscaling/v2beta2 kind: HorizontalPodAutoscaler metadata: name: podinfo namespace: test annotations: metric-config.external.prometheus-query.prometheus/processed-requests-per-second: | sum( rate( istio_requests_total{ destination_workload="podinfo", destination_workload_namespace="test", reporter="destination" }[1m] ) ) spec: maxReplicas: 10 minReplicas: 1 scaleTargetRef: apiVersion: apps/v1 kind: Deployment name: podinfo metrics: - type: External external: metric: name: prometheus-query selector: matchLabels: query-name: processed-requests-per-second target: type: AverageValue averageValue: "10"執行以下命令,部署HPA。

kubectl apply -f hpa.yaml執行以下命令,驗證HPA是否部署成功。

列出Prometheus適配器提供的自定義外部指標。

kubectl get --raw "/apis/external.metrics.k8s.io/v1beta1" | jq .預期輸出:

{ "kind": "APIResourceList", "apiVersion": "v1", "groupVersion": "external.metrics.k8s.io/v1beta1", "resources": [ { "name": "prometheus-query", "singularName": "", "namespaced": true, "kind": "ExternalMetricValueList", "verbs": [ "get" ] } ] }返回結果中包含自定義的ASM指標的資源列表,說明HPA部署成功。

驗證自動彈性伸縮

執行以下命令,進入測試器容器,并使用hey命令生成工作負載請求。

kubectl -n test exec -it ${loadtester} -c loadtester -- sh ~ $ hey -z 5m -c 10 -q 5 http://podinfo.test:9898執行以下命令,查看自動伸縮狀況。

說明默認情況下,指標每30秒執行一次同步,并且只有在最近3分鐘~5分鐘內容器沒有重新縮放時,才可以進行放大或縮小。這樣,HPA可以防止沖突決策的快速執行,并為集群自動擴展程序預留時間。

watch kubectl -n test get hpa/podinfo預期輸出:

NAME REFERENCE TARGETS MINPODS MAXPODS REPLICAS AGE podinfo Deployment/podinfo 8308m/10 (avg) 1 10 6 124m一分鐘后,HPA將開始擴大工作負載,直到請求/秒降至目標值以下。負載測試完成后,每秒的請求數將降為零,并且HPA將開始縮減工作負載Pod數量,幾分鐘后上述命令返回結果中的REPLICAS副本數將恢復為一個。